Hollywood já entendeu: a inteligência artificial não é uma moda passageira, mas um agente de mudança profunda na maneira como filmes são criados, produzidos e distribuídos. Estúdios como Warner Bros., Paramount e até produtoras independentes vêm incorporando IA em etapas estratégicas da produção — do roteiro à pós. Mas esse movimento não se resume às grandes produções. A verdadeira revolução está acontecendo também nas mãos de artistas individuais, diretores independentes e estudantes, que agora têm acesso a ferramentas antes impensáveis.

Sim, a IA pode ajudar a criar cenas, personagens e até mesmo mundos inteiros — mas nada disso substitui o olhar do artista. O que muda é a escala da realização. Com o domínio técnico certo, é possível hoje fazer o trabalho de uma pequena equipe com o auxílio de ferramentas generativas. Isso não é um delírio futurista — é realidade presente. E quem está prestando atenção já começou a experimentar.

IA não é mágica. Mas é poderosa.

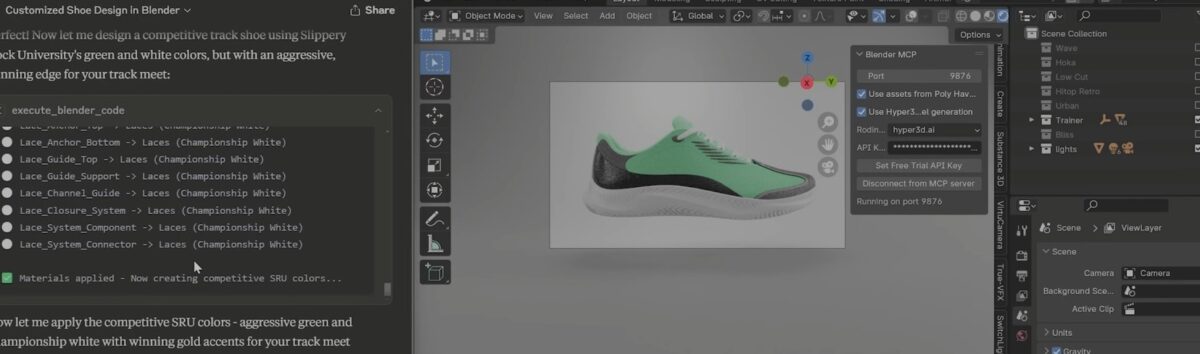

No Unreal Engine 5, por exemplo, já é possível usar IA para gerar variações de cenário, paletas de cores e atmosferas visuais sem sair do ambiente 3D. No Blender, APIs como as do Claude, da Anthropic, permitem integrar agentes procedurais que constroem modelos com base em comandos naturais. Esse tipo de integração transforma o artista em algo mais próximo de um diretor-orquestrador de sistemas criativos.

E não é só nos softwares 3D. Ferramentas como Veo, Runway’s Gen-3 Alpha ou Pika permitem animar ideias com base em conceitos cinematográficos. Quem entende de ritmo, corte, luz, movimento de câmera — quem tem bagagem de cinema — consegue usar prompts bem pensados para dirigir cenas inteiras. O modelo Flow, por exemplo, interpreta imagens e aplica efeitos cinematográficos coerentes com movimento e profundidade.

Essa é a chave: não existe botão mágico. Existe técnica. A IA não faz por você — ela potencializa o que você sabe fazer.

Inspiração virou ação

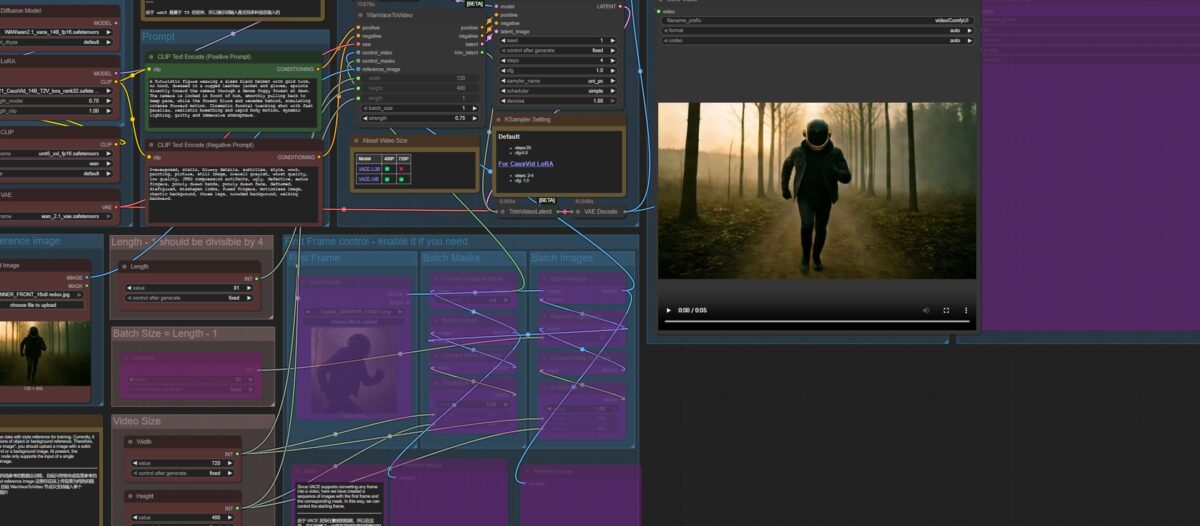

Como profissional da área, já atuei como diretor e assistente de direção em produções que exigem visualização antecipada para orientar fotógrafos, diretores de arte e cenógrafos. Nesse contexto, a IA generativa tem sido uma aliada fundamental. Aprendi a usar o ComfyUI para gerar imagens localmente, com controle total dos fluxos criativos — mesmo com uma GPU RTX 3060 de 12GB, consigo rodar modelos robustos como SDXL, HiDream e Flux. Além disso, integro APIs da Runway para complementar o pipeline, e recorro à nuvem para processamentos mais pesados.

A possibilidade de montar cenários, testar atmosferas, explorar estéticas visuais e até simular iluminação diretamente do meu ambiente local mudou minha forma de trabalhar. E essa autonomia técnica é libertadora. O que antes exigia equipe, orçamento e tempo, agora pode ser prototipado em horas.

IA no mainstream: Adobe, Lightricks e as grandes viradas

Enquanto isso, empresas como a Adobe vêm incorporando IA de forma profunda em suas ferramentas profissionais. Seu modelo Firefly foi treinado exclusivamente com conteúdo licenciado ou de domínio público, evitando os conflitos legais enfrentados por outras plataformas. Hoje, o Photoshop, Premiere e After Effects oferecem recursos como preenchimento generativo, extensão de takes e substituição de elementos — todos impulsionados por IA e otimizados para o fluxo de trabalho de criadores experientes.

Outro exemplo relevante vem da Lightricks, empresa por trás de apps como o Videoleap. Em parceria com a Shutterstock, a Lightricks está treinando seus modelos com vídeo HD e 4K licenciado, garantindo qualidade e respeito aos direitos autorais. O lançamento da LTXV 0.9 como projeto open source, em 2024, mostra um comprometimento com a transparência e com o futuro da IA generativa voltada para vídeo.

Essas abordagens contrastam com polêmicas recentes. Um exemplo notório é o processo movido pela Disney e Marvel contra a Midjourney, alegando uso indevido de material protegido por copyright para treinar modelos de geração visual. O embate levanta uma questão central: quem é o autor de uma imagem criada por IA? O artista? O programador? A empresa? O próprio modelo?

Ferramentas gratuitas, limites e possibilidades

Além dos fluxos locais com ComfyUI, também faço uso de ferramentas online gratuitas quando o objetivo é apenas visualizar ideias rapidamente, sem necessidade de controle técnico fino. Um exemplo que se destaca é o Google Image FX. Ele gera imagens em alta resolução, com aspect ratios variados, e uma interpretação de prompt extremamente refinada — que enriquece silenciosamente os comandos textuais, facilitando resultados sofisticados sem exigir conhecimento técnico aprofundado. É uma das ferramentas mais rápidas que já usei no navegador.

Por outro lado, serviços como o Flux Playground, da Black Forest, mostram o poder das soluções comerciais: usando o modelo Flux Kontext, é possível com pouquíssimas palavras editar imagens com precisão — trocar cores de roupas, alterar cenários ou incorporar artes próprias em cenas com altíssima fidelidade visual. São métodos complexos, altamente especializados, que me inspiram a desenvolver versões customizadas locais em meus próprios workflows.

Vivemos uma era em que desenvolvedores não param — e a IA não dorme.

Reflexão final

A IA está transformando o cinema, sim — mas não pelo fim do artista. Pelo contrário: ela devolve poder criativo a quem tem visão. Em vez de esperar verba, equipe ou aval de algum produtor, hoje um estudante pode montar um curta inteiro a partir de ideias, imagens, som e tempo. A barreira de entrada caiu. A curva de aprendizado existe, mas nunca foi tão possível experimentar, errar e acertar com velocidade.

O momento não é de medo. É de imaginação ativa.